Agentmemory

#1 Codex、Hermes、OpenClaw、Claude ++ 的持久内存

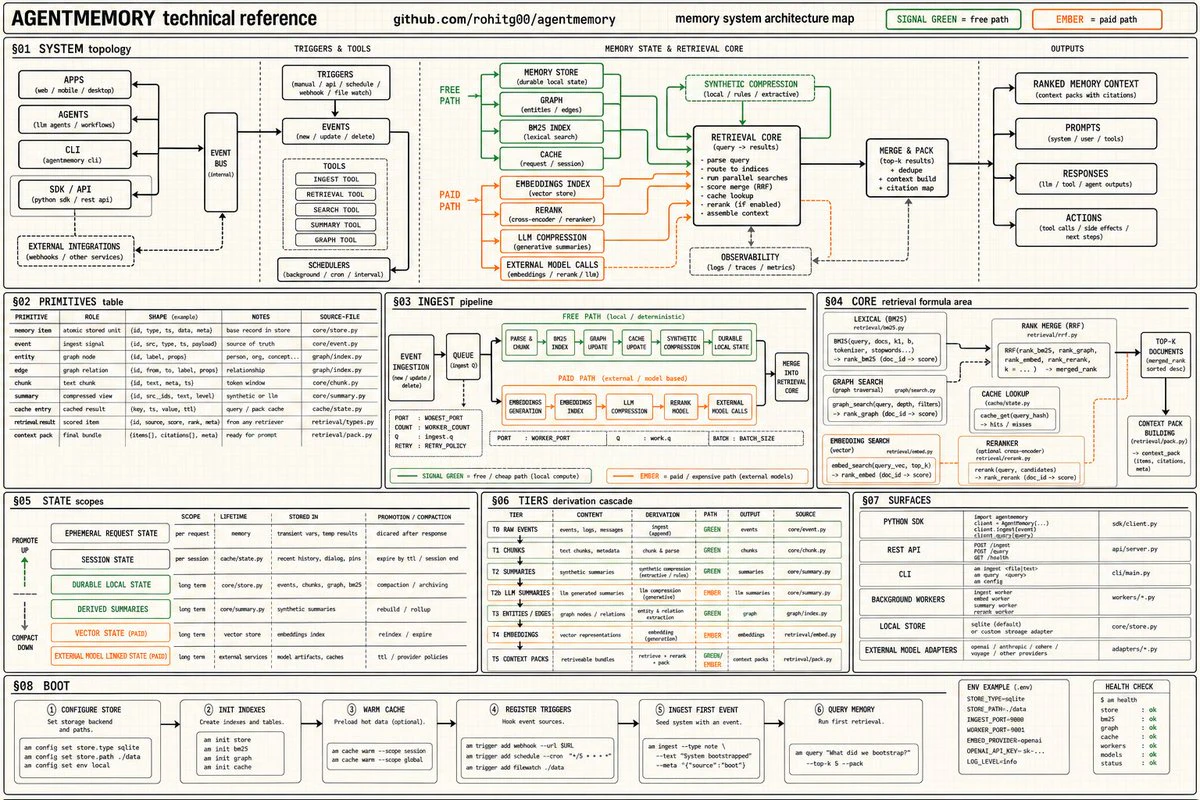

现在您可以为 Hermes、Claude Code 和 Codex 提供无限内存。Agentmemory 在 GitHub 上广受欢迎,拥有超过 5000 个星标。CLAUDE md 在 240 次观察中将超过 22000 个 token 转储到上下文中,而 agentmemory 仅需 1900 个 token,观察次数相同,但数量减少了 92%。在 1000 次观察中,80% 的内置内存将变得不可见。agentmemory 可保持 100% 的可搜索性。在 240 次真实编码会话中进行基准测试 → 每次会话最多减少 95% 的 token → 在达到上下文限制之前,工具调用次数增加 200 倍 → 100% 开源

AI 分析

Agentmemory 为 Codex、Hermes、Claude Code 和 OpenClaw 等 AI 编码助手提供持久无限内存。它将超过 22,000 个 token 的观察数据压缩到约 1,900 个 token(减少 92%),同时保持 100% 内存可搜索,不像内置上下文在 1,000 个观察时丢失 80% 可见性。在 240 个真实编码会话上的基准测试显示,每个会话 token 减少高达 95%,工具调用增加 200 倍直至达到上下文限制。作为拥有 5,000+ 星标的热门 100% 开源 GitHub 项目,它解决了长时间 AI 交互中上下文窗口耗尽和内存退化的关键痛点,为开发者提供高效、可扩展的内存管理。

在 2025-2026 年,AI 代理生态系统正在爆炸式增长,Claude、GPT 变体和自主编码工具的采用范围更广。随着代理处理更长会话和更复杂任务,上下文窗口管理和高效内存已成为核心瓶颈。在 API 成本上升的情况下,用户对 token 高效解决方案的需求激增。这与向生产级 AI 代理发展的行业趋势完美契合。优秀时机。

高。解决方案已经开发、基准测试并作为成熟的开源 GitHub 项目发布,具有显著吸引力(5k+ 星标)。内存压缩和搜索的技术复杂性已解决。对于 OSS 工具,开发和运营成本低;没有硬件供应链或重大合规风险。在 LLM 生态系统中具有强大的可扩展潜力,尽管持续维护依赖社区贡献。

主要用户:AI/ML 工程师、软件开发者和独立黑客,他们正在构建或使用带有 Claude、Codex 或类似 LLM 的自主编码代理。人口统计:技术熟练,25-45 岁,全球分布,在美国、欧洲和亚洲科技中心高度集中。行业:软件开发、AI 工具。AI 开发工具的 TAM 超过 100 亿美元;代理内存/RAG 解决方案的 SAM 约 10 亿美元。核心痛点:长会话中的上下文限制和内存丢失。尽管核心是 OSS 模型,但对高级支持或托管版本有较高的付费意愿。

中。直接竞争对手:1. MemGPT (memgpt.ai),2. LangChain/LangGraph Memory 模块 (langchain.com),3. Zep (getzep.com),4. Mem0 (mem0.ai),5. LlamaIndex (llamaindex.ai)。优势:针对 Claude/Codex 的编码会话进行了基准测试的卓越 token 压缩(减少 95%),完全可搜索性保证,纯开源且 GitHub 吸引力高。劣势:较新的进入者,范围可能比通用 RAG 框架窄,与一些竞争对手相比缺乏完善的企業功能或托管云服务。

升级 Pro 解锁完整 AI 分析